“星际之门”计划捧红了这家云服务公司,化废弃能源为AI算力,估值达百亿美金

“星际之门”计划捧红了这家云服务公司,化废弃能源为AI算力,估值达百亿美金几个月前,和 OpenAI“星际之门”(Stargate)项目的合作,让 Crusoe 这家公司一夜成名。据创始人介绍,公司的名字灵感来源于小说《鲁滨逊漂流记》(Robinson Crusoe),正像鲁滨逊在荒岛上竭力利用全部资源来生存一样,这家公司也试图最大化利用废弃或闲置能源,并通过算力来释放其价值。

搜索

搜索

几个月前,和 OpenAI“星际之门”(Stargate)项目的合作,让 Crusoe 这家公司一夜成名。据创始人介绍,公司的名字灵感来源于小说《鲁滨逊漂流记》(Robinson Crusoe),正像鲁滨逊在荒岛上竭力利用全部资源来生存一样,这家公司也试图最大化利用废弃或闲置能源,并通过算力来释放其价值。

传闻许久的 OpenAI AI Agent 浏览器,如今这个靴子终于正式落地。但 AI 浏览器已经是巨头新贵正在不断涌入的赛道,OpenAI 还未正式下场,就已经有了十足的火药味:预热推文评论区最高赞的评论,就是一名用户表示自己已经卸载了 Chrome,等待 Atlas,颇有点「打扫卫生再请客」的感觉。

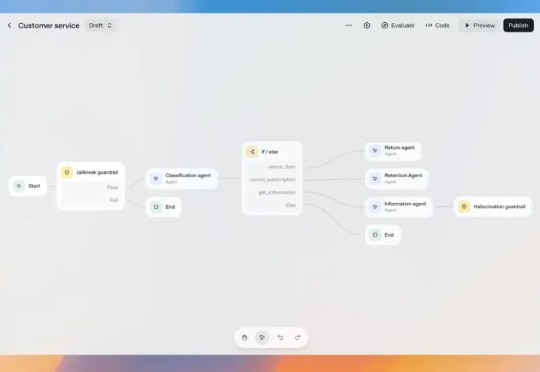

在几天前的开发者大会上,OpenAI 发布了一套面向开发者和企业的完整工具集 AgentKit。其中,可视化画布 Agent Builder 用于创建、管理和版本化多智能体工作流,通过拖拽节点的方式即可编辑工作流。

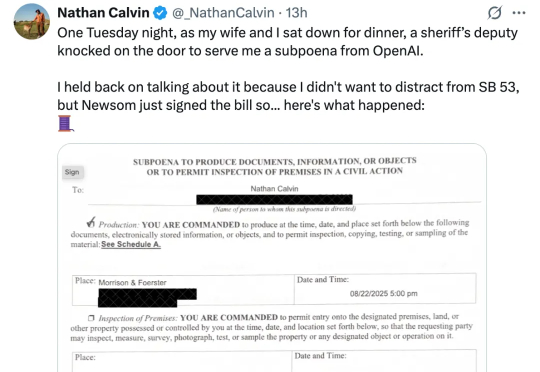

几个小时前,一位名为 Nathan Calvin 的 X 网友发推文称,「一个周二晚上,我和妻子正准备吃晚饭,一位副警长敲门,递给了我一张 OpenAI 的传票」。该传票不仅涉及他所在的 Encode 组织,还要求 Calvin 提供与加州立法者、大学生和前 OpenAI 员工的私人信息。而这一切都与一项近期通过的名为 SB 53 的法案有关。

整场访谈中,Altman 展现出一种难得的坦诚。他承认 OpenAI 在某些测试上输给了竞争对手, 承认提前发布 Sora 是为了让社会接受假视频的冲击, 承认「AI slop」(AI 垃圾) 确实是个问题——但话锋一转,他补充道:人类自己也一直在制造烂活儿。

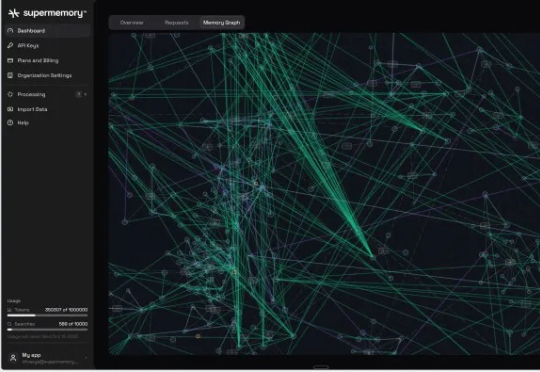

Supermemory 已获得由 Susa Ventures、Browder Capital 和 SF1.vc 领投的 260 万美元种子轮融资。此轮融资还包括 Cloudflare 的 Knecht、谷歌人工智能负责人 Jeff Dean、DeepMind 产品经理 Logan Kilpatrick、Sentry 创始人 David Cramer 以及来自 OpenAI、

在 AI 圈里,聚光灯总是追逐着那些履历光鲜的明星人物。但一个伟大的团队,不仅有台前的明星,更有无数在幕后贡献关键力量的英雄。之前我们介绍了 OpenAI 的两位波兰工程师,最近 OpenAI 又一位身处幕后的工程师成为了焦点。

蚂蚁通用人工智能中心自然语言组联合香港大学自然语言组(后简称“团队”)推出PromptCoT 2.0,要在大模型下半场押注任务合成。实验表明,通过“强起点、强反馈”的自博弈式训练,PromptCoT 2.0可以让30B-A3B模型在一系列数学代码推理任务上实现新的SOTA结果,达到和DeepSeek-R1-0528, OpenAI o3, Gemini 2.5 Pro等相当的表现。

正当大家都在预测牌桌上的其他巨头何时出手时,行业领头羊 OpenAI 的「王炸」似乎已经提前被剧透了,那就是 Sora 2。最近,OpenAI 不仅在 X 平台连发多条神秘视频,引爆社区对 Sora 2 的猜想。

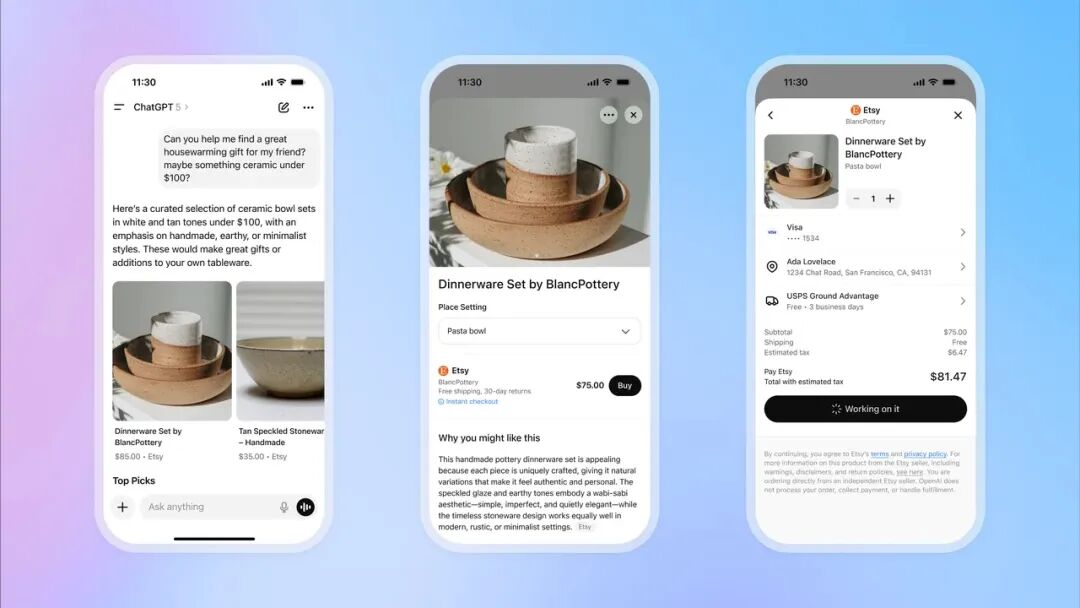

新官上任三把火,自从 OpenAI 应用部门 CEO Fidji Simo 上岗之后,动作也是接连不断。 之前就有消息传出, Fidji Simo 正在组建新团队,准备给 ChatGPT 引入广告业务,新团队负责人更是要全面操盘 OpenAI 的盈利大计,广告也好订阅也罢,反正就是要把钱赚到位。